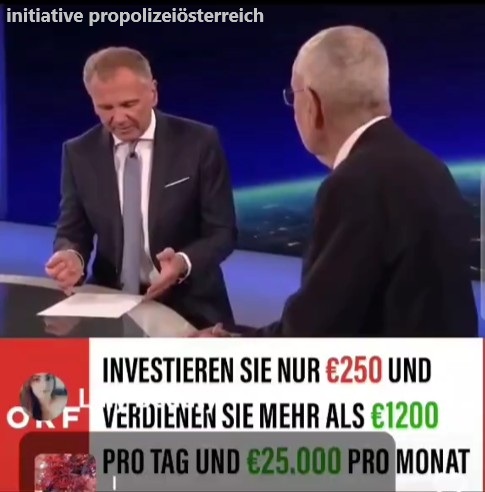

Was auf den ersten Blick wie ein harmloser Scherz wirkt, entpuppt sich als ernsthafte Gefahr: Deep-Fakes in Kombination mit Identitätsdiebstahl sind eine neue Herausforderung, die zunehmend Besorgnis erregt. Heute wurde in Österreich ein besonders erschreckender Fall bekannt, bei dem manipulierte Inhalte verbreitet wurden, die angeblich von Bundespräsident Alexander Van der Bellen, Bundeskanzler Karl Nehammer und dem ORF stammten.

Deep-Fakes: Neuer Betrug mit Stimmen von Van der Bellen und Nehammer!Auf den ersten Blick mag es wie ein harmloser Scherz erscheinen, doch die Gefahr ist real: Deep-Fakes in Kombination mit Identitätsdiebstahl sind ein neuer und besorgniserregender Trend. Heute wurde über mehrere Kanäle in Österreich ein besonders alarmierender Fall bekannt: Mit den Stimmen von Bundespräsident Alexander Van der Bellen, Bundeskanzler Karl Nehammer und dem ORF wurden manipulierte Inhalte verbreitet. Dieser Fall zeigt, wie künstliche Intelligenz für täuschend echt wirkende Fälschungen genutzt werden kann. Solche Deep-Fakes könnten in Zukunft vermehrt als Werkzeug für politische Angriffe und zur Verbreitung von Desinformation und Fake-News eingesetzt werden. Warum ist das so gefährlich? Deep-Fakes lassen gefälschte Botschaften glaubwürdig erscheinen und erschweren die Unterscheidung zwischen Wahrheit und Täuschung. Sie können das Vertrauen in staatliche Institutionen und öffentliche Persönlichkeiten nachhaltig erschüttern. Wie sollten Bürgerinnen und Bürger reagieren?Verdächtige Inhalte umgehend bei der Plattform (z.B. Facebook) melden. Sofort Anzeige bei der Polizei oder RTR erstatten, um eine Strafverfolgung einzuleiten. Keinesfalls auf verdächtige Links klicken, um Ihre persönlichen Daten zu schützen. Dieser Vorfall ist ein Weckruf: Die Gefahren solcher Technologien dürfen nicht unterschätzt werden. Es liegt an uns allen, wachsam zu sein und solche Trends entschieden zu bekämpfen. (Quelle: Unabhängige Ermittlungseinheit Pro Polizei Österreich)

Gepostet von Pro Polizei Österreich am Donnerstag, 18. Juli 2024

Die täuschend echt wirkenden Fälschungen wurden durch den Einsatz künstlicher Intelligenz erstellt und verdeutlichen das enorme Missbrauchspotenzial dieser Technologie. Solche Deep-Fakes könnten künftig gezielt für politische Angriffe oder die Verbreitung von Desinformation und Fake-News verwendet werden.

Warum ist KI-Deepfake problematisch?

Deep-Fakes machen es immer schwieriger, zwischen echten und manipulierten Botschaften zu unterscheiden. Sie können gefälschte Inhalte glaubwürdig erscheinen lassen und das Vertrauen in staatliche Institutionen sowie öffentliche Persönlichkeiten nachhaltig beschädigen. Die gesellschaftlichen Folgen solcher Täuschungen könnten gravierend sein – von politischer Destabilisierung bis hin zu einer Verunsicherung der Bevölkerung.

Wie kann man sich schützen?

- Verdächtige Inhalte melden: Informieren Sie die Plattform, auf der solche Inhalte auftauchen (z. B. Facebook oder Instagram).

- Anzeige erstatten: Wenden Sie sich an die Polizei oder die Rundfunk- und Telekom-Regulierungsbehörde (RTR), um solche Vorfälle zu melden.

- Keine Links anklicken: Vermeiden Sie es, auf verdächtige Links zu klicken, um Ihre persönlichen Daten zu schützen.

Dieser Vorfall ist ein Weckruf: Die Gefahren von Deep-Fakes dürfen nicht unterschätzt werden. Es liegt an uns allen, wachsam zu bleiben und entschieden gegen die Verbreitung solcher Inhalte vorzugehen. Behörden, Plattformbetreiber und die Gesellschaft sind gefordert, geeignete Maßnahmen zu setzen, um diese Bedrohung einzudämmen. Seien RTR und KommAustria bereit!

Quelle: Unabhängige Ermittlungseinheit Pro Polizei Österreich

Schreibe einen Kommentar